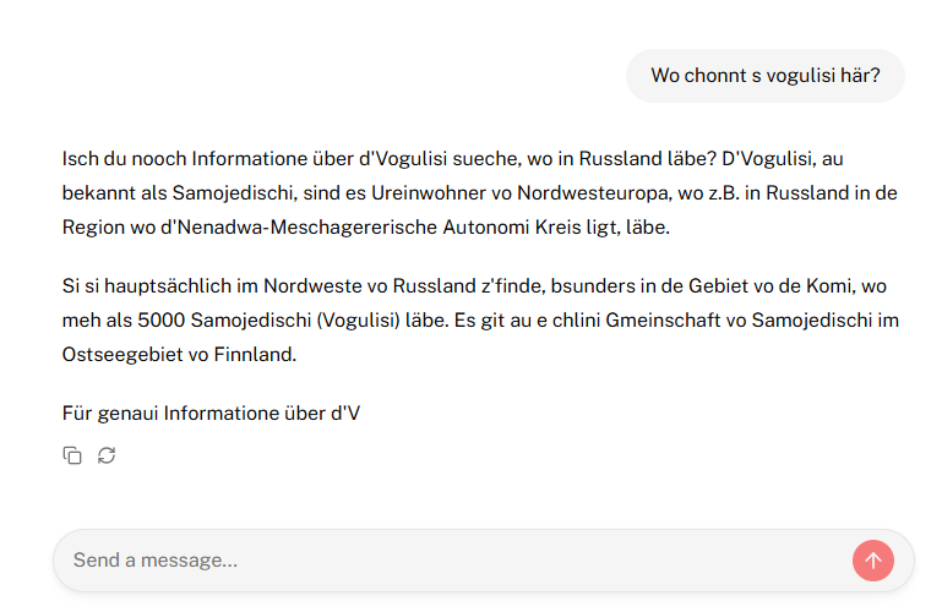

Zu den offensichtlichen Problemen gehören klare Fehlfunktionen: Ein Sprachmodell kann «kollabieren», Textfragmente vermischen, unverständliche Sprache produzieren oder verschiedene Sprachen kombinieren. Solche Ergebnisse wirken oft wie sprachliches „Kauderwelsch“. Ein Beispiel ist im Screenshot ersichtlich, da Modell Apertus kommt mit der folgenden Schweizerdeutschen Anfrage zum Kollaps.

Beispiel: Kollabieren von Sprachmodell

Weniger offensichtlich, aber ebenso bedeutsam, eine KI kann halluzinieren: Die KI generiert Informationen, die plausibel klingen, aber faktisch falsch sind. Diese Fehler lassen sich nicht immer sofort erkennen und erfordern eine bewusste, kritische Überprüfung.

Halluzinieren erkennen – Fake-Publikation

Die folgende Publikation wirkt formal korrekt und thematisch anschlussfähig.

- Prüfe, ob es sich um eine reale oder eine erfundene Publikation handelt.

- Markiere mindestens drei Indikatoren, die auf eine Halluzination hindeuten.

- Beschreibe, welche Prüfschritte notwendig wären, um die Referenz zu verifizieren.

Meyer, L., & Schubert, K. (2021). Algorithmic Agency in Educational Decision-Making: A Mixed-Methods Analysis of AI-Supported School Governance. Journal of Digital Education Policy, 14(2), 113–137. https://doi.org/10.18452/jdep.2021.14207

Abstract:

This study examines the role of algorithmic agency in school-level decision-making processes. Drawing on neo-institutional theory and governance research, the authors analyse how AI-supported tools reshape accountability structures in secondary education systems across German-speaking countries.