Wie KI Informationen in Zahlen übersetzt

Bevor wir verstehen können, wie künstliche Intelligenz lernt, muss eine grundlegende Frage geklärt werden: Wie kann ein Computer überhaupt mit Bildern, Text oder Sprache arbeiten?

Computer können nur mit Zahlen rechnen. Deshalb müssen alle Informationen zuerst in eine mathematische Form gebracht werden. Genau hier kommt die Vektorisierung ins Spiel: Informationen (z. B. Bilder, Wörter oder Töne) werden in Zahlenfolgen umgewandelt, sogenannte Vektoren. Diese Vektoren beschreiben die Eigenschaften oder Bedeutung der Daten so, dass ein Modell damit rechnen kann.

Verbindung zur Mathematik: Vektoren im 2D- und 3D-Raum

Vielleicht kennst du Vektoren noch aus dem Mathematikunterricht. Ein Vektor kann dort z. B. eine Position im Raum beschreiben:

- (2, 1) → Punkt im 2D-Koordinatensystem

- (3, −1, 4) → Punkt im 3D-Raum

Jeder Vektor zeigt also auf eine bestimmte Position im Raum. Genau dieselbe Idee nutzt auch KI. Nur beschreibt der Raum jetzt keine physische Position, sondern Eigenschaften oder Bedeutung. Und es gibt oft nicht nur 2 oder 3 Dimensionen, sondern hunderte oder tausende. Anstatt von Positionen im Raum stellen die Werte der Vektoren Repräsentationen für die unterschiedlichen Dimensionen unserer Informationen dar, z.B.: Grösse, Farbe, Form, Emotion, Kontext, etc.

Warum man trotzdem oft 2D/3D-Räume zur Visualisierung nutzt

Die echten Vektorräume moderner KI sind viel zu hochdimensional, um sie zu visualisieren. Deshalb nutzt man oft eine 3D-Vorstellung als vereinfachtes Denkmodell.

Diese Vereinfachung ist hilfreich, weil wir so verstehen können:

- Nähe bedeutet Ähnlichkeit

- Richtungen haben Bedeutung

- Unterschiede lassen sich messen

- Beziehungen werden geometrisch sichtbar

Auch wenn die echte Struktur komplexer ist, bleibt die Logik gleich. Stell dir vor, jedes Wort bekommt je nach Bedeutung eine Position im Raum wie in den folgenden Beispielen:

Beispiele für Vektordarstellungen

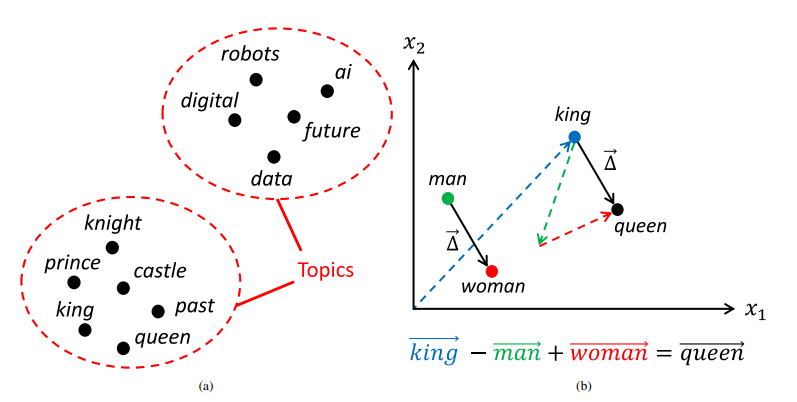

Quelle: Steur, N. A., & Schwenker, F. (2021). Next-generation neural networks: Capsule networks with routing-by-agreement for text classification. IEEE Access, 9, 125269-125299.

Im linken Beispiel kann man sehen, dass vektorisierte Wörter mit einem ähnlichen Kontext im 2D Raum näher beieinander sind:

- «Mittelalterliche Themen»: König, Königin, Prinz, Schloss, Ritter etc.

- «Futuristische Themen»: Daten, digital, KI, Roboter, etc.

Spannend wird es, wenn Beziehungen als Richtungen im Raum erscheinen. Im rechten Beispiel kann man sehen, dass man durch die Vektorisierung nun auch Vektorarithmetik verwenden kann um Beziehungen zwischen den Wörtern zu «berechnen»:

König − Mann + Frau ≈ Königin

Der Unterschied zwischen Mann und Frau bildet eine Richtung und diese kann auf andere Begriffe übertragen werden, z.B. auf König und Königin.

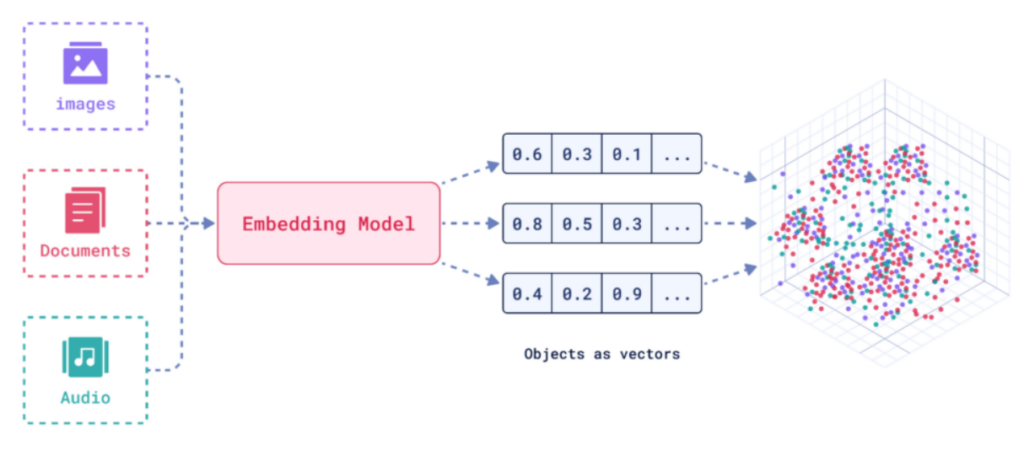

Wie KI aus Bildern, Texten oder Audio Vektoren macht

KI-Modelle lernen, wie sie Informationen automatisch in Zahlen darstellen können. Dazu analysieren sie sehr viele Beispiele und entdecken dabei selbst, welche Merkmale wichtig sind:

- Bilder: Das Modell erkennt Muster wie Kanten, Formen, Texturen oder Objekte.

- Text: Es lernt, welche Wörter häufig zusammen vorkommen und in ähnlichen Bedeutungszusammenhängen stehen.

- Audio: Es erkennt Strukturen wie Tonhöhe, Klangfarbe oder Rhythmus.

Aus diesen erkannten Merkmalen erzeugt das Modell eine kompakte numerische Darstellung – einen Vektor, der die wichtigsten Eigenschaften der Information zusammenfasst. Solche bedeutungsvollen Vektordarstellungen nennt man Embeddings. Ein Embedding beschreibt also, was etwas bedeutet oder ausmacht, in Zahlenform. Ähnliche Inhalte erhalten ähnliche Embeddings. Dadurch kann die KI z. B.:

- Ähnlichkeiten berechnen

- Inhalte gruppieren

- Beziehungen erkennen

- Informationen vergleichen oder kombinieren

- Dinge vorhersagen

Visualisierung des Vektorisierungsprozesses

Embeddings sind damit die Grundlage dafür, dass KI Bedeutungen mathematisch verarbeiten kann. Jetzt da wir diese Grundlage haben, können wir uns in den nächsten Kapiteln genauer anschauen wie KI-Modelle trainiert werden.