Prompting

Es gibt einige etablierte Grundregeln für das Prompten, also für das Formulieren von Anweisungen in natürlicher Sprache an Sprachmodelle. Ziel ist es, möglichst direkt zu einem passenden Ergebnis zu kommen – ohne zahlreiches Nachjustieren.

- Bei der Struktur «Rolle – Aufgabe – Format» gehören diese drei Aspekte in den allerersten Prompt. Wie z.B.: «Als Sek-1-Lehrperson für Französisch (Rolle) benötige ich 10 Übungssätze zum Thema Imperativ. Es sollen Beispiele aus dem Alltag sein (Aufgabe). Liste die Sätze auf und setze die Lösungen in Klammern (Format).»

- Eine weitere etablierte Struktur heisst One Shot / Few Shot. Sprachmodelle arbeiten präzise, wenn eine Textreferenz mitgeliefert wird. Anstatt lange zu beschreiben, wie das Ergebnis aussehen soll, gibt man einfach ein fertiges Paar aus «Eingabe» und «gewünschter Ausgabe» als Muster vor.

Beispiel aus dem Englisch-Unterricht (One-Shot):

Du möchtest einfache Sätze generieren lassen. Dein Prompt an die KI lautet:

«Erstelle einfache Beispielsätze für die 5. Klasse. Mache es genau wie in diesem Beispiel:

Wort: Dog

Ergebnis: The dog plays in the garden.

Dein Auftrag – Wort: Ball»

Durch das Beispiel «Dog» weiss das Tool nun genau, wie der Satz sein muss und generiert für «Ball» automatisch das passende Sprachniveau z. B.: «The boy kicks the red ball.». Wäre die Aufgabe schwieriger z. B. unregelmässige Verben, würden Sie hier einfach zwei bis drei solcher Beispiel-Paare auflisten (= Few Shot), damit das Muster vom Sprachmodell reproduziert werden kann.

Auch wenn diese Prompt-Strukturen zielführend sind, ist es normal, dass man nach dem ersten Output den Prompt nochmals nachjustieren muss. Das ist gut möglich, da der Chatbot jeweils den gesamten bisherigen Chatverlauf mitberücksichtigt. Deshalb ist es sinnvoll, für jedes neue Thema einen neuen Chat zu eröffnen. Es ist also nicht empfehlenswert, zunächst über Freizeit-Themen zu chatten und danach im selben Chat Fachinformationen abzufragen.

Sprachmodelle im sprachlichen Bereich

Generative Sprachmodelle sind darauf trainiert, Sprache zu reproduzieren. Daher eignet sich ihr Einsatz besonders für Sprachoptimierungen, Stiländerungen oder Übersetzungen. In diesem Anwendungsbereich sind Fehler vergleichsweise selten.

Sprachmodelle für Inhaltliche Abfragen

In der Technologie von Sprachmodellen sind keine inhaltlichen Konzepte hinterlegt; entsprechend sind Fehler und Unschärfen im Output möglich. Da Sprachmodelle Sätze auf Basis von Wahrscheinlichkeiten generieren, bleibt eine gewisse Unschärfe dieser Technologie grundsätzlich erhalten.

Als Faustregel gilt: Gut dokumentierte Themen sind in den Trainingsdaten stark vertreten und werden daher mit höherer Wahrscheinlichkeit korrekt generiert. Bei weniger bekannten, lokalen oder sehr spezifischen Fakten besteht hingegen ein erhöhtes Risiko für inhaltlich falsche Angaben – sogenannte Halluzinationen. Diese klingen oft plausibel und sind sprachlich überzeugend, sind aber inhaltlich falsch. Fakten aus KI-Antworten sollten daher regelmässig mit einer Websuche überprüft und mit zwei bis drei vertrauenswürdigen Quellen abgeglichen werden. Dieser Fakten-Check sollte Teil der Arbeitsroutine sein.

Die Unschärfe von Sprachmodellen verträgt sich zudem schlecht mit der Präzision, die in naturwissenschaftlichen Bereichen wie Mathematik, Chemie oder Physik erforderlich ist. Für entsprechende Fragestellungen empfiehlt es sich, spezialisierte Tools zu verwenden, etwa Wolfram Alpha oder MathGPT. Bei solchen KI-Tools sind Sprachmodelle mit symbolischen Ansätzen (z. B. mathematischen oder physikalischen Funktionen) gekoppelt, weshalb in der Regel zuverlässigere Ergebnisse zu erwarten, aber Fehler weiterhin wahrscheinlich sind.

Die gleiche Problematik zeigt sich auch beim Erstellen von Quellenangaben. Die Präzision, die korrekte Referenzen erfordern, können viele generative Sprachmodelle nicht zuverlässig leisten. Es ist daher stets mit Fehlern zu rechnen – etwa mit nicht existierenden Publikationen, ungenauen bibliografischen Angaben oder nicht funktionierenden Links.

Texte zusammenfassen lassen

Das Zusammenfassen von Texten ist eine verbreitete Anwendung, die jedoch eine kritische Prüfung erfordert. Da KI kein Verständnis von Relevanz und Vollständigkeit besitzt, bleibt es ungewiss, ob alle wichtigen Aspekte des Originaltextes tatsächlich enthalten sind. Es kann hilfreich sein, im Prompt bereits konkret Aspekte zu benennen, welche in der Zusammenfassung zwingend berücksichtigt werden sollen.

Ein Upload von Textdokumenten zur Zusammenfassung ist nur zulässig, wenn die Zustimmung der Urheberschaft vorliegt. Nicht erlaubt ist es, einen Text aus einem geschützten Bibliotheksbereich hochzuladen. Anders verhält es sich bei bereits öffentlich zugänglichen Texten; hier ist anzunehmen, dass diese ohnehin schon für KI-Trainingszwecke verwendet wurden.

RAG für mehr inhaltliche Präzision

Ein reines Sprachmodell verfügt meist über 3-6 Monate veraltete Trainingsdaten. Lokale oder aktuelle Abfragen mit einem Sprachmodell zu tätigen, ist also nicht zu empfehlen.

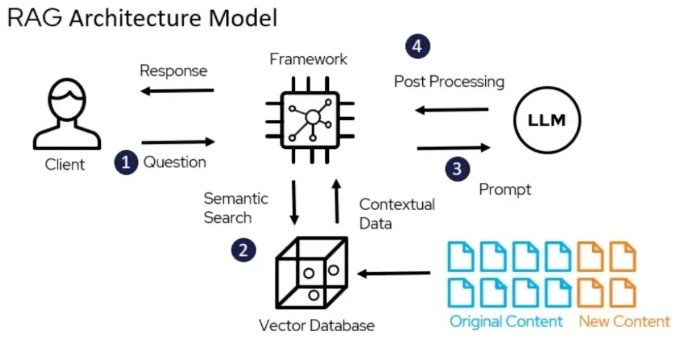

Für aktuelle oder lokale Abfragen gibt es eine Lösung: Sprachmodelle, die an eine Suchinfrastruktur gekoppelt sind. So ein Framework nennt sich RAG (Retrieval Augmented Generation) und zeichnet sich wie folgt aus: Schlüsselbegriffe aus dem Prompt des Nutzers werden mit einer aktuellen und gut kuratierten Suchinfrastruktur abgeglichen. Das Ergebnis aus der Suchinfrastruktur stellt anschliessend die Grundlage das Sprachmodell zur Verfügung, welches damit den Output generiert. Bekannte Vertreter sind Microsoft Copilot und PerplexityAI. Dieses RAG-Framework ist in der folgenden Darstellung ersichtlich:

Visualisierung RAG-Architektur

Aktivität: RAG-Simulation

Gehe auf https://www.behind-ai.ch/rag und starte die RAG-Simulation. Bei dieser Simulation lässt sich beobachten, wie ein Sprachmodell ohne RAG versus ein Sprachmodell mit RAG auf die selbe Frage antwortet.

Inzwischen zeigt der Trend in folgende Richtung: Sehr viele generative KI Tools verwenden bereits RAG im Hintergrund um aktuelle, präzise und fundierte Outputs generieren zu können. Es ist davon auszugehen, dass künftig so gut wie alle KI-Tools ein RAG-Framework verwenden werden.

Inhaltliche Präzision durch Text-Upload

Beim Erkunden eines Fachinhalts und bei vorhandenen Fachtexten empfiehlt es sich, diese Texte (einen oder mehrere) im KI-Tool hochzuladen und den Prompt beispielsweise mit folgender Anweisung zu ergänzen: «Beantworte meine Fragen ausschliesslich auf Basis des hochgeladenen Textes.» Die hochgeladenen Dokumente werden im Kontextfenster des Sprachmodells gespeichert und bei entsprechender Anweisung bei der Generierung der Antworten berücksichtigt. Diese Nähe zum zugrunde liegenden Fachtext erhöht in der Regel die inhaltliche Präzision. Gleichzeitig entsteht eine zusätzliche Überprüfungsmöglichkeit: Viele Tools können die jeweilige Passage im Originaltext anzeigen oder verlinken, aus der die Information entnommen wurde.

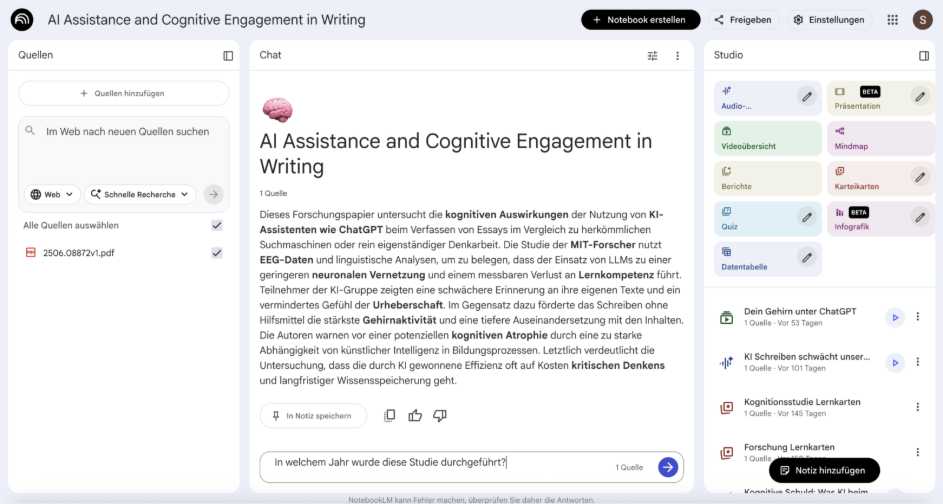

Ein KI-Tool, welches genau das mit dem Dokument-Upload anbietet, ist «Notebook LM» von Google https://notebooklm.google Das Tool ist kostenlos, erfordert allerdings ein Login mit einem Google-Konto. Notebook LM bietet die Option einen oder mehrere Texte und Weblinks als Quelle hochzuladen und beantwortet Fragen der Nutzer auf Basis von diesen Quellen. Des Weiteren lässt sich über die hochgeladenen oder verlinkten Quellen ein Podcast, Erklärvideo, Lern-Karteikarten und vieles mehr erstellen.

Beispiel NotebookLM

Multimodale und datenschutzkonforme Tools

Inzwischen gibt es eine grosse Anzahl unterschiedlicher KI-Tools zur Generierung von Texten, Bildern, Videos oder Audio. Besonders praktisch sind sogenannte multimodale Tools: Sie können verschiedene Arten von Input – etwa Text, PDFs, Sprache oder Bilder – verarbeiten und unterschiedliche Outputs wie Text, Bilder oder Sprache erzeugen. Bekannte Vertreter solcher Tools sind beispielsweise ChatGPT oder Google Gemini.

Für den Einsatz an Schulen bieten sich insbesondere loginfreie Optionen an, etwa ChatGPT oder Microsoft Copilot. Wichtig ist dabei der Hinweis, dass keine persönlichen Daten eingegeben werden dürfen. Darüber hinaus existieren auch KI-Tools, die speziell für den Einsatz im Bildungsbereich entwickelt wurden und erhöhte Datenschutzstandards erfüllen. Beispiele hierfür sind die KI-Dienste von Schabi oder Fobizz.

KI-Detektoren

Ein omnipräsentes Thema im schulischen Kontext sind KI-Detektoren. Viele Lehrpersonen haben das Bedürfnis, Texte von Schüler*innen durch einen Detektor prüfen zu lassen und eine Einschätzung zu erhalten, zu welchem Anteil ein Text von einer KI generiert oder von Menschen geschrieben wurde.

Solche Detektoren funktionieren jedoch nicht zuverlässig – und werden dies voraussichtlich auch künftig nicht leisten können.